Introdução

No mundo contemporâneo, as plataformas digitais tornaram-se centrais para a economia, a comunicação e a vida social. Empresas como Google, Facebook, Amazon e Tencent não apenas revolucionaram setores inteiros, mas também influenciam significativamente a forma como as pessoas interagem, consomem informação e participam da vida pública. Com esse poder expansivo, surge um debate crítico: como regular essas plataformas de maneira eficaz, protegendo os usuários e a sociedade, sem sufocar a inovação tecnológica?

A União Europeia tem liderado esforços regulatórios com iniciativas como o Digital Services Act (DSA) e o Digital Markets Act (DMA), buscando responsabilizar plataformas por conteúdos e práticas algorítmicas, além de promover a concorrência justa. Simultaneamente, países como a China adotam abordagens mais restritivas, enfatizando o controle estatal e a soberania digital. Nos Estados Unidos, o debate se concentra na proteção da liberdade de expressão e na responsabilidade das plataformas.

No Brasil, o debate sobre a regulação de plataformas digitais intensificou-se, especialmente em questões como a responsabilização algorítmica, a proteção de crianças e adolescentes, o combate à desinformação e a garantia de concorrência justa. Este post explora os argumentos a favor e contra a regulação dessas plataformas e apresenta propostas para o Brasil, visando equilibrar a proteção dos direitos fundamentais, a promoção da inovação e o desenvolvimento econômico.

Contexto Global da Regulação Digital

União Europeia: Responsabilização e Transparência

A União Europeia tem sido pioneira na regulação das plataformas digitais. O DSA e o DMA, aprovados em 2022, estabelecem obrigações claras para serviços digitais, visando aumentar a transparência, combater conteúdos ilegais e promover a concorrência justa. De acordo com o Centre for European Policy Studies, essas legislações introduzem conceitos inovadores, como a responsabilidade das plataformas pelos algoritmos de recomendação que utilizam.

Por que isso é importante? Porque os algoritmos de recomendação influenciam ativamente quais conteúdos os usuários veem, podendo amplificar desinformação, discurso de ódio ou polarização política. Ao reconhecer que as plataformas não são meros intermediários neutros, mas atores ativos na formação da esfera pública digital, a UE busca responsabilizá-las por suas escolhas algorítmicas.

China: Soberania Digital e Controle Algorítmico

A China adota uma abordagem distinta, focada no controle estatal sobre as plataformas digitais. Com a implementação da Lei de Proteção de Informação Pessoal (PIPL) e regulações específicas sobre algoritmos, o país busca proteger dados pessoais e controlar o fluxo de informação. As plataformas são obrigadas a revelar o funcionamento de seus algoritmos ao Estado e implementar medidas para prevenir a disseminação de conteúdo considerado nocivo.

Estados Unidos: Debates sobre Liberdade e Responsabilidade

Nos Estados Unidos, a discussão gira em torno da Seção 230 do Communications Decency Act, que concede imunidade às plataformas em relação ao conteúdo gerado por usuários. Há um debate acirrado sobre se as plataformas devem ser responsabilizadas quando seus algoritmos promovem ou amplificam conteúdo prejudicial. Casos de desinformação e incitação à violência intensificaram a pressão por uma revisão dessa legislação.

Argumentos Pró Regulação

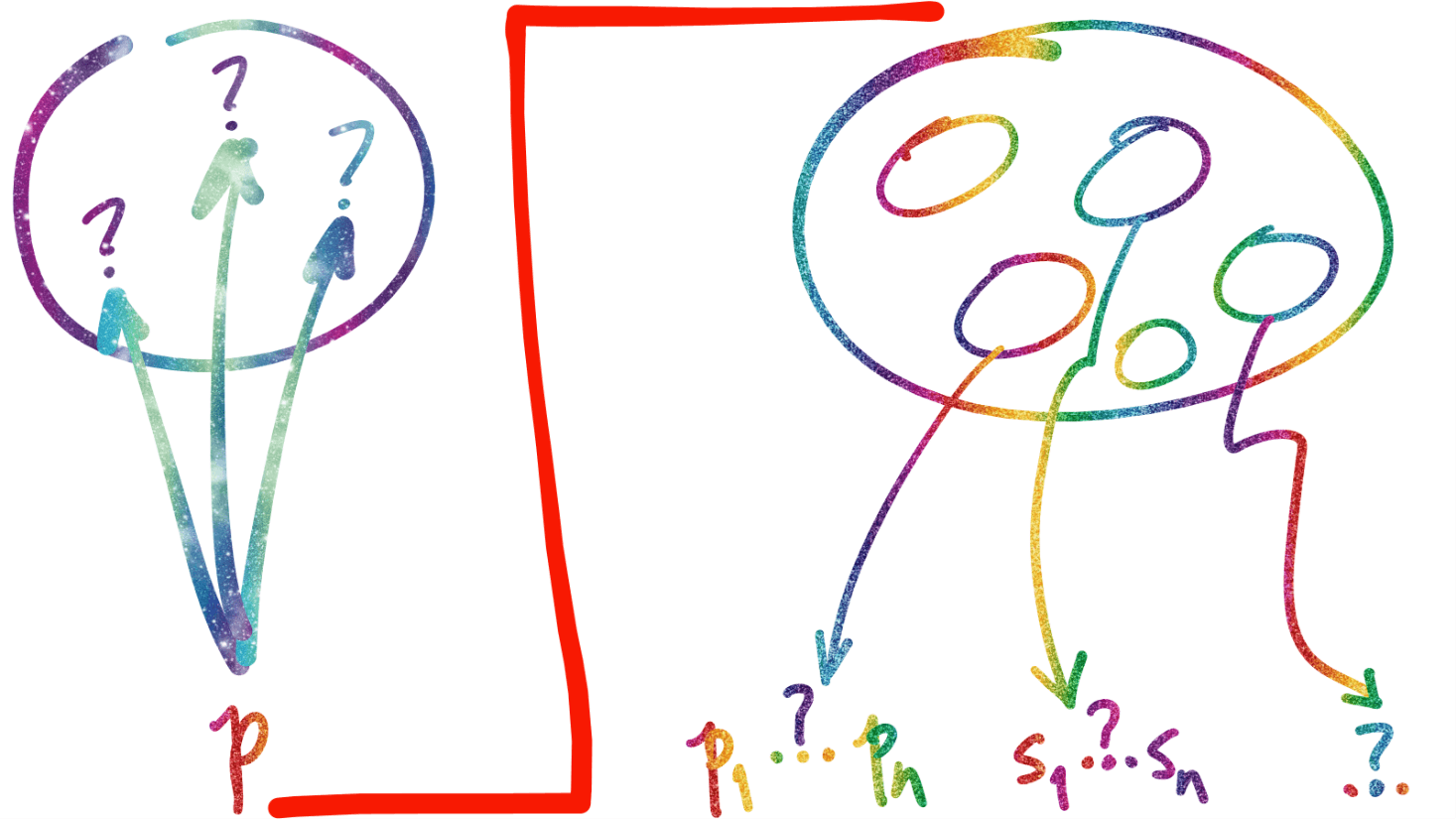

1. Responsabilização Algorítmica das Plataformas

O desafio: Os algoritmos de recomendação utilizados pelas plataformas digitais não são neutros. Eles determinam quais conteúdos são exibidos aos usuários, influenciando significativamente suas percepções, opiniões e comportamentos. Esses algoritmos podem criar bolhas de filtro (filter bubbles) e câmaras de eco (echo chambers), onde os usuários são expostos apenas a informação que reforçam suas crenças existentes, isolando-os de perspectivas divergentes.

Argumento: Dada a influência dos algoritmos na formação da opinião pública e no comportamento individual, é fundamental que as plataformas sejam responsabilizadas pelas consequências de suas escolhas algorítmicas. A falta de transparência e accountability permite que as plataformas priorizem o engajamento e o lucro acima do bem-estar dos usuários e da sociedade.

Em detalhe:

-

Bolhas de Filtro e Polarização: Os algoritmos tendem a mostrar aos usuários conteúdos que correspondem às suas preferências e histórico de navegação. Embora isso possa melhorar a experiência do usuário a curto prazo, a longo prazo, contribui para a polarização política e social, pois os indivíduos são expostos apenas a visões que confirmam seus preconceitos, dificultando o diálogo e a compreensão mútua.

-

Amplificação de Conteúdos Nocivos: Estudos mostram que conteúdos extremos ou sensacionalistas geram mais engajamento. Consequentemente, os algoritmos podem amplificar desinformação, discurso de ódio e teorias da conspiração, já que esses conteúdos mantêm os usuários mais engajados na plataforma.

-

Exemplo Prático: Durante as eleições, algoritmos podem promover conteúdos polarizadores ou falsos que influenciam a opinião pública e o resultado eleitoral. Na pandemia de COVID-19, a disseminação de desinformação sobre vacinas e tratamentos foi exacerbada por algoritmos que priorizaram conteúdos engajadores, independentemente de sua veracidade.

-

Responsabilização Necessária: Se as plataformas são atores ativos na curadoria de conteúdo por meio de seus algoritmos, elas devem ser responsabilizadas pelas consequências dessas ações. Isso inclui a obrigação de transparência algorítmica, permitindo que reguladores e pesquisadores entendam como as decisões algorítmicas são tomadas e como afetam os usuários.

-

Regulação Proposta: Estabelecer normas que exijam que as plataformas avaliem o impacto social de seus algoritmos, implementem medidas para mitigar danos potenciais e sejam transparentes sobre os critérios utilizados em seus sistemas de recomendação. Isso pode incluir auditorias independentes e relatórios regulares sobre práticas algorítmicas.

Referências:

-

Pariser, E. (2011). The Filter Bubble: What the Internet Is Hiding from You. Este livro explora como a personalização online isola os indivíduos em bolhas de informação.

-

Sunstein, C. R. (2017). #Republic: Divided Democracy in the Age of Social Media. Discute como as redes sociais contribuem para a fragmentação da sociedade.

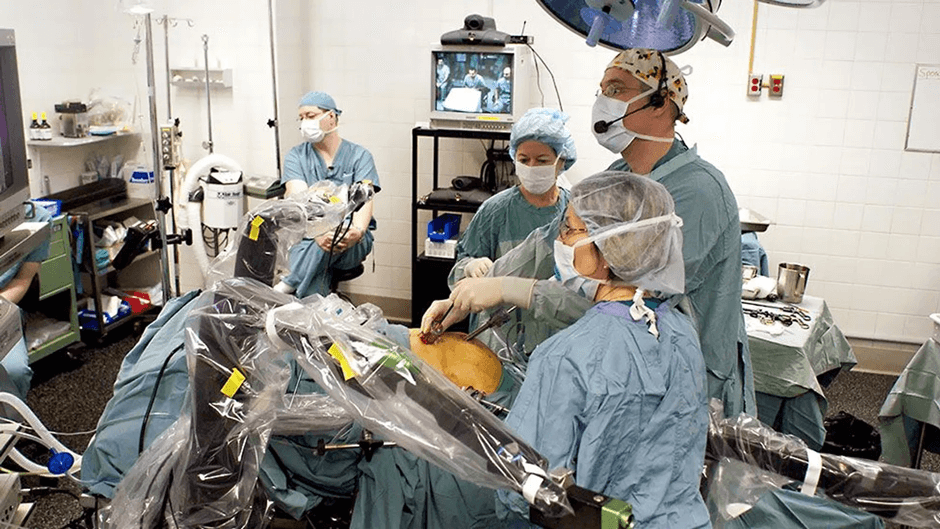

2. Proteção de Crianças e Adolescentes

O desafio: Crianças e adolescentes estão cada vez mais presentes no ambiente digital, onde enfrentam riscos como exposição a conteúdos inadequados, cyberbullying, aliciamento e exploração sexual. As plataformas muitas vezes não têm mecanismos eficazes para proteger os menores de idade desses perigos.

Argumento: É essencial estabelecer regulamentações que protejam os jovens no ambiente online. Isso inclui limitar o acesso de menores a plataformas não apropriadas para sua idade e garantir que as plataformas implementem medidas de segurança robustas.

Em detalhe:

-

Exposição a Conteúdos Inadequados: Sem restrições adequadas, menores podem facilmente acessar material violento, sexualmente explícito ou que promove comportamentos nocivos, afetando seu desenvolvimento psicológico e emocional.

-

Cyberbullying e Saúde Mental: As interações online podem expor crianças e adolescentes a assédios e bullying, com impactos negativos na saúde mental, incluindo ansiedade, depressão e, em casos extremos, tendências suicidas.

-

Aliciamento e Exploração Sexual: Plataformas com recursos de comunicação podem ser usadas por predadores para aliciar menores. A falta de verificação de idade facilita o acesso de crianças a ambientes inseguros.

-

Verificação de Idade e Identidade: Regulamentações podem exigir que as plataformas implementem sistemas de verificação de idade para impedir o acesso de menores a conteúdos inadequados. Embora isso levante preocupações sobre privacidade, soluções tecnológicas como criptografia de ponta a ponta e verificações de idade sem coleta de dados pessoais sensíveis podem mitigar esses riscos.

-

Responsabilidade das Plataformas: Além de restringir o acesso, as plataformas devem ser obrigadas a monitorar e remover conteúdos ilegais ou prejudiciais envolvendo menores, além de reportar às autoridades competentes quando necessário.

Referências:

-

Livingstone, S., & Third, A. (2017). Children and Young People’s Rights in the Digital Age: An Emerging Agenda. Explora os direitos das crianças no contexto digital.

-

UNICEF (2021). Políticas para um Ambiente Digital Seguro para Crianças. Fornece diretrizes para a proteção de menores online.

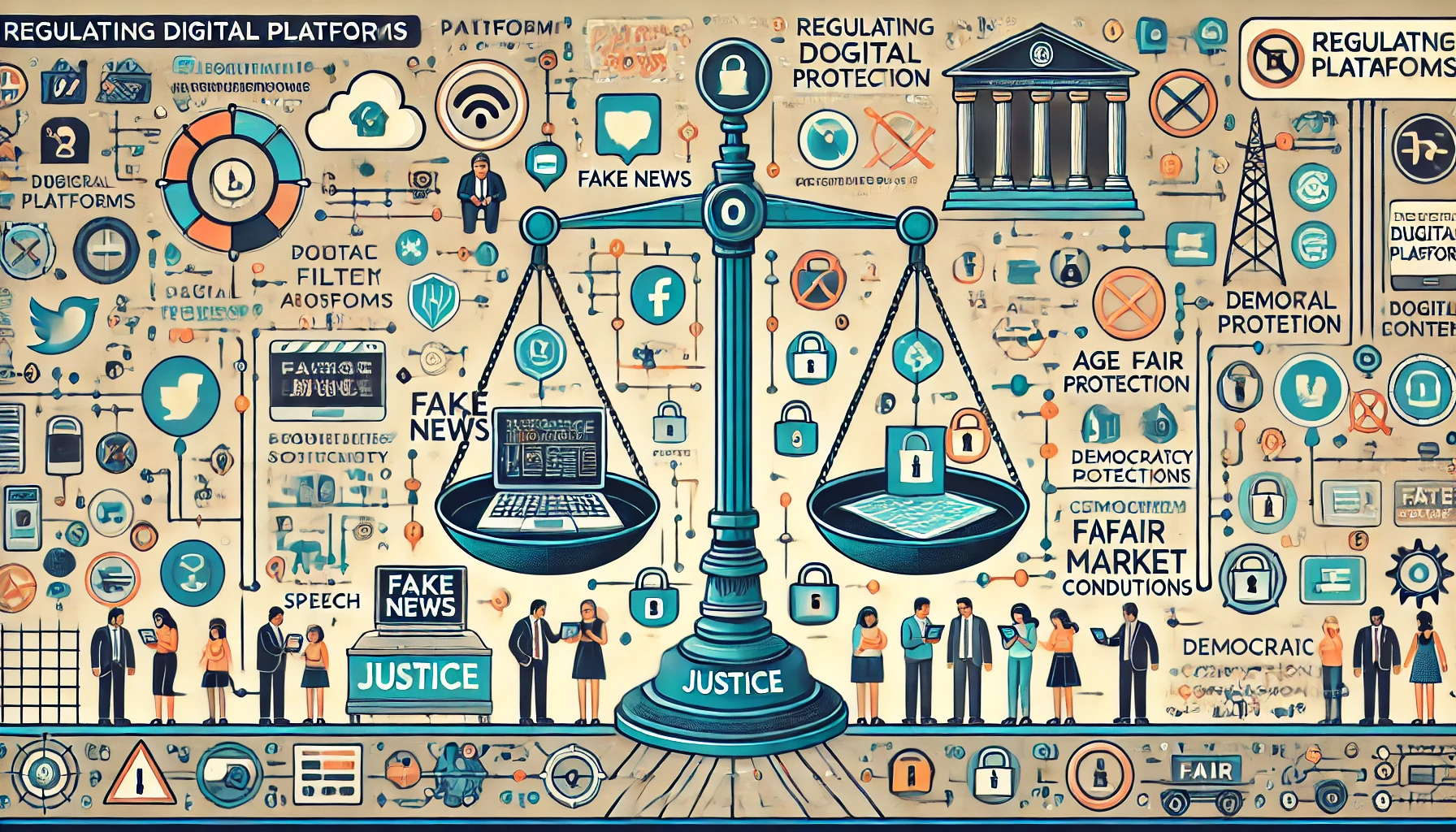

3. Combate à Desinformação e Preservação da Democracia

O desafio: A desinformação se propaga rapidamente nas plataformas digitais, influenciando opiniões públicas, eleições e políticas governamentais. A facilidade de disseminação de fake news ameaça a integridade dos processos democráticos e pode incitar violência e desordem social.

Argumento: Regulamentar as plataformas para que atuem no combate à desinformação é crucial para preservar a democracia e a coesão social. As plataformas devem ser responsáveis por monitorar, sinalizar e remover conteúdos comprovadamente falsos ou manipulativos.

Em detalhe:

-

Impacto nas Eleições: A manipulação de informação pode influenciar resultados eleitorais, como evidenciado em investigações sobre interferências estrangeiras em eleições de diversos países.

-

Saúde Pública e Segurança: Durante crises de saúde, como a pandemia de COVID-19, a desinformação sobre tratamentos e vacinas pode levar a comportamentos prejudiciais e retardar a resposta efetiva à crise.

-

Incitação à Violência: Fake news podem instigar violência étnica, religiosa ou política, resultando em conflitos e perdas de vidas.

-

Responsabilidade das Plataformas: As plataformas têm os recursos técnicos e a capacidade para identificar e limitar a disseminação de desinformação. Regulamentações podem obrigá-las a implementar políticas claras contra fake news, utilizar verificadores de fatos e promover conteúdo de fontes confiáveis.

-

Liberdade de Expressão vs. Proteção Social: Embora a liberdade de expressão seja um direito fundamental, ela não é absoluta. A regulamentação deve buscar um equilíbrio entre proteger esse direito e prevenir danos sociais significativos causados pela desinformação.

Referências:

-

Wardle, C., & Derakhshan, H. (2017). Information Disorder: Toward an Interdisciplinary Framework for Research and Policy Making. Aborda os diferentes tipos de desinformação e estratégias de combate.

-

Vosoughi, S., Roy, D., & Aral, S. (2018). The spread of true and false news online. Science, 359(6380), 1146-1151. Estudo que demonstra como as fake news se espalham mais rapidamente que notícias verdadeiras.

4. Garantia de Concorrência Justa

O desafio: Grandes plataformas digitais, devido ao efeito de rede e à concentração de dados, podem dominar mercados inteiros, sufocando a concorrência e impedindo a entrada de novos atores. Isso pode levar à formação de monopólios ou oligopólios, prejudicando consumidores e a inovação.

Argumento: Intervenções regulatórias são necessárias para assegurar uma concorrência justa, promover a diversidade de serviços e evitar práticas anticompetitivas que possam prejudicar o mercado e os consumidores.

Em detalhe:

-

Efeitos de Rede: Quanto mais usuários uma plataforma tem, mais valiosa ela se torna para outros usuários, criando barreiras naturais à entrada de novos competidores.

-

Práticas Anticompetitivas: Grandes plataformas podem adotar estratégias como preços predatórios, aquisição de potenciais concorrentes ou uso de dados coletados para competir deslealmente.

-

Inovação Prejudicada: A falta de concorrência reduz o incentivo para inovação, levando a menos opções e qualidade inferior para os consumidores.

-

Regulação Antitruste: Leis e regulamentações antitruste podem prevenir abusos de poder de mercado. Isso inclui limitar fusões e aquisições que prejudicam a concorrência, impor separações estruturais ou funcionais e garantir acesso equitativo a infraestruturas essenciais.

-

Exemplo Prático: Investigações e ações contra gigantes tecnológicos em diversas jurisdições, como a UE e os EUA, têm abordado questões como auto-preferência em resultados de busca, controle de marketplaces e condições desleais impostas a desenvolvedores de aplicativos.

Referências:

-

Khan, L. M. (2017). Amazon’s Antitrust Paradox. The Yale Law Journal, 126(3), 710-805. Analisa como a legislação antitruste tradicional pode ser inadequada para lidar com plataformas digitais.

-

Stigler Committee on Digital Platforms (2019). Final Report. Recomendações sobre políticas para promover a concorrência em mercados digitais.

5. Proteção de Direitos Fundamentais e Privacidade

O desafio: As plataformas digitais coletam e processam enormes quantidades de dados pessoais, muitas vezes sem o pleno conhecimento ou consentimento dos usuários. Isso pode levar a violações de privacidade, discriminação algorítmica e outros abusos.

Argumento: Regulamentações robustas são necessárias para proteger os direitos fundamentais dos indivíduos, especialmente o direito à privacidade, garantindo que os dados pessoais sejam tratados de forma ética e segura.

Em detalhe:

-

Coleta Massiva de Dados: As plataformas utilizam técnicas avançadas de rastreamento e perfilamento para coletar dados sobre comportamento, localização, preferências e interações dos usuários.

-

Riscos de Discriminação: Algoritmos podem perpetuar ou exacerbar preconceitos existentes, levando a discriminações em áreas como emprego, crédito ou acesso a serviços.

-

Vazamentos e Uso Indevido de Dados: Incidentes de segurança podem expor dados sensíveis, enquanto dados podem ser compartilhados ou vendidos sem o consentimento dos usuários.

-

Regulamentações como a LGPD: Estabelecem princípios como finalidade específica, minimização de dados, consentimento informado e direitos dos titulares dos dados, incluindo acesso, retificação e exclusão.

-

Papel das Autoridades Reguladoras: Entidades como a ANPD são essenciais para fiscalizar o cumprimento da lei, orientar as organizações e aplicar sanções quando necessário.

Referências:

-

Zuboff, S. (2019). The Age of Surveillance Capitalism. Explora como empresas coletam e utilizam dados pessoais para influenciar comportamentos.

-

Acquisti, A., Brandimarte, L., & Loewenstein, G. (2015). Privacy and human behavior in the age of information. Science, 347(6221), 509-514. Discute a importância da privacidade e como as pessoas percebem a coleta de dados.

Considerações Finais sobre os Argumentos a Favor da Regulação:

A regulação das plataformas digitais é apresentada como uma necessidade para proteger a sociedade dos efeitos negativos que podem advir do funcionamento não supervisionado dessas empresas. A responsabilização algorítmica, a proteção de crianças e adolescentes, o combate à desinformação, a garantia de concorrência justa e a proteção de direitos fundamentais são áreas críticas que requerem intervenção regulatória.

As plataformas digitais, embora ofereçam inúmeros benefícios, também têm um poder significativo para influenciar comportamentos e mercados. Sem uma estrutura regulatória adequada, esse poder pode ser exercido de maneira prejudicial aos indivíduos e à sociedade como um todo. Portanto, a regulação é vista não como um impedimento ao progresso e à inovação, mas como um meio de assegurar que esse progresso ocorra de forma ética, responsável e alinhada com o bem comum.

Argumentos Contra Regulação

1. Risco à Inovação e ao Desenvolvimento Tecnológico

Argumento: A imposição de regulamentações excessivas ou complexas pode sufocar a inovação e inibir o desenvolvimento tecnológico, especialmente para startups e pequenas empresas que não dispõem dos recursos necessários para cumprir requisitos regulatórios rigorosos. Um ambiente regulatório flexível é visto como essencial para fomentar a criatividade, permitindo que novas ideias e tecnologias floresçam sem obstáculos desnecessários.

Em detalhe:

-

Barreiras de Entrada Elevadas: Regulamentações complexas podem criar barreiras significativas para a entrada de novos concorrentes no mercado. Startups, em particular, podem ser desproporcionalmente afetadas pelos custos de conformidade, documentação e processos legais, dificultando sua capacidade de competir com grandes empresas estabelecidas que têm recursos mais amplos.

-

Inovação Prejudicada: Muitas das inovações mais significativas surgem de empresas menores que desafiam o status quo. Regulamentações rígidas podem limitar a capacidade dessas empresas de experimentar e implementar soluções de ruptura, favorecendo a manutenção de modelos de negócios tradicionais.

-

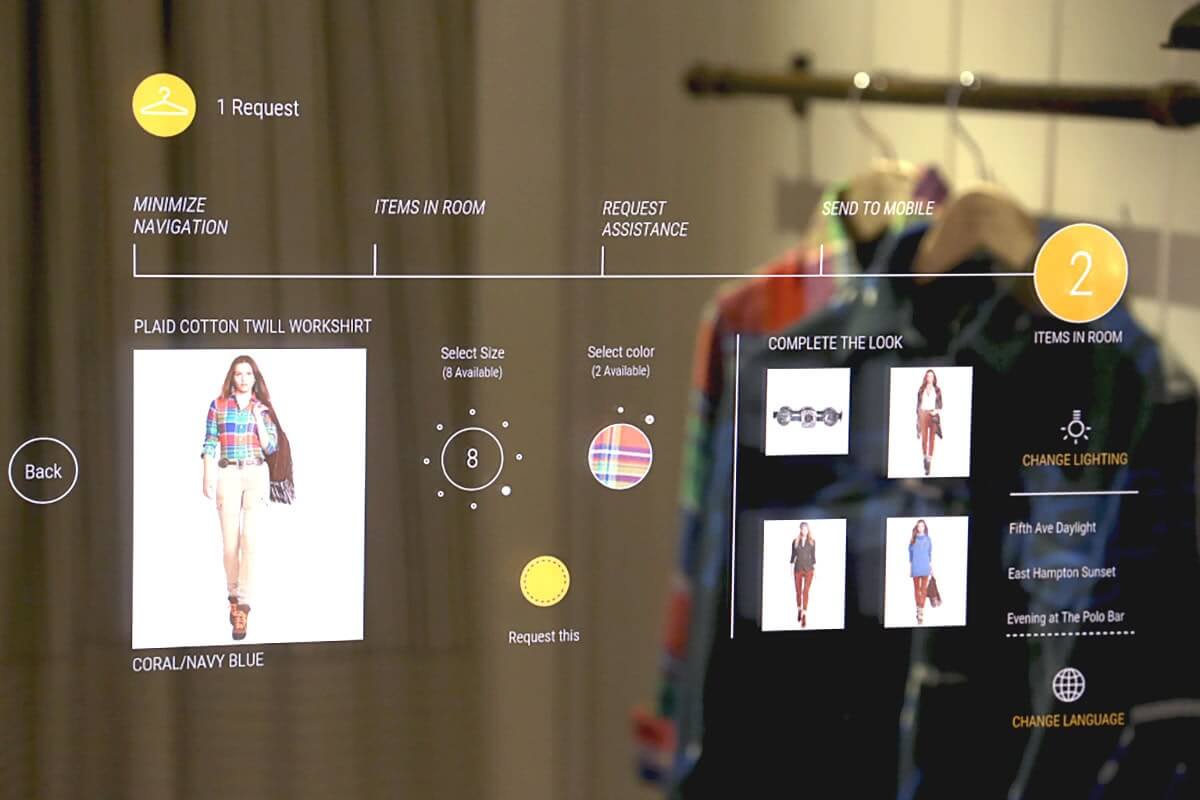

Flexibilidade Necessária para a Tecnologia Emergente: Tecnologias emergentes, como inteligência artificial, blockchain e Internet das Coisas, evoluem rapidamente e frequentemente em direções inesperadas. Regulamentações estáticas podem não acompanhar esse ritmo, restringindo o potencial dessas tecnologias e atrasando sua adoção.

-

Exemplo Prático: A indústria de drones enfrentou desafios regulatórios significativos em diversos países. Requisitos rigorosos para registro, licenciamento e uso do espaço aéreo retardaram o desenvolvimento e a implementação de soluções inovadoras em áreas como entrega de produtos, agricultura de precisão e inspeção de infraestruturas.

-

Perspectiva do Setor: O Innovation Policy Forum (2023) argumenta que ambientes regulatórios que priorizam a flexibilidade e a adaptabilidade são mais propensos a estimular o crescimento econômico e a competitividade global. Políticas que promovem a autorregulação e incentivos à inovação podem ser mais eficazes do que regulamentações restritivas.

Referências:

-

Porter, M. E. (1990). The Competitive Advantage of Nations. Discute como políticas governamentais podem influenciar a competitividade e a inovação.

-

Baldwin, R., & Cave, M. (1999). Understanding Regulation: Theory, Strategy, and Practice. Analisa como a regulação pode afetar diferentes setores econômicos.

2. Desafios na Implementação de Verificações de Idade e Identidade

Argumento: A implementação de sistemas de verificação de idade e identidade nas plataformas digitais pode invadir a privacidade dos usuários, criar barreiras ao acesso e não ser efetiva na proteção de menores. Além disso, tais sistemas podem ser tecnicamente complexos e suscetíveis a falhas, permitindo que menores contornem as restrições.

Em detalhe:

-

Invasão de Privacidade: Requerer que os usuários forneçam informação pessoais para verificar sua idade ou identidade pode levantar preocupações significativas de privacidade. Os usuários podem ser obrigados a compartilhar documentos de identidade, fotos ou outros dados sensíveis, aumentando o risco de vazamentos de dados e roubo de identidade.

-

Barreiras ao Acesso: Processos de verificação podem tornar o acesso a plataformas mais complicado e demorado, desencorajando o uso legítimo. Usuários podem enfrentar dificuldades técnicas ou desistir de utilizar o serviço devido à complexidade adicional.

-

Eficácia Limitada: Menores podem encontrar maneiras de burlar os sistemas de verificação, utilizando identidades falsas, contas de terceiros ou informação enganosa. Assim, as medidas podem não atingir o objetivo de proteger crianças e adolescentes.

-

Desafios Técnicos e Custos: Desenvolver e manter sistemas de verificação robustos requer investimentos significativos em tecnologia e segurança. Pequenas empresas podem não ter recursos para implementar tais sistemas, prejudicando sua competitividade.

-

Impacto sobre a Inclusão Digital: Populações vulneráveis ou com menor acesso a documentos oficiais (por exemplo, pessoas sem documentos de identidade, refugiados ou indivíduos em áreas remotas) podem ser excluídas das plataformas, aprofundando desigualdades digitais.

-

Problema não Trivial: A implementação de sistemas de verificação de idade e identidade é tecnicamente desafiadora e pode não oferecer uma solução eficaz para a proteção de menores, ao mesmo tempo em que impõe riscos à privacidade e barreiras ao acesso.

Referências:

-

Cohen, J. E. (2012). Configuring the Networked Self: Law, Code, and the Play of Everyday Practice. Explora as implicações da coleta de dados pessoais e a tensão entre segurança e privacidade.

-

Article 29 Data Protection Working Party (2012). Opinion 02/2012 on facial recognition in online and mobile services. Discute os riscos associados ao uso de tecnologias de reconhecimento para verificação de identidade.

3. Complexidade Técnica e Obsolescência Regulamentar

Argumento: A tecnologia evolui em um ritmo acelerado, e regulamentações podem rapidamente se tornar obsoletas ou inadequadas. Leis rígidas e específicas podem não acompanhar inovações emergentes, como inteligência artificial avançada, realidade virtual, tecnologias descentralizadas (como blockchain) e outras tendências ainda não previstas. Isso pode levar a lacunas regulatórias, insegurança jurídica e obstáculos ao progresso tecnológico.

Em detalhe:

-

Ritmo Acelerado da Inovação: O ciclo de desenvolvimento tecnológico é muito mais rápido do que o processo legislativo. Regulamentações podem levar anos para serem elaboradas e aprovadas, enquanto novas tecnologias podem surgir e se disseminar em questão de meses.

-

Obsolescência Regulamentar: Regulamentações específicas podem se tornar irrelevantes ou prejudiciais quando aplicadas a novas tecnologias que não existiam ou não eram previstas no momento de sua elaboração.

-

Incerteza Jurídica: Empresas podem enfrentar dificuldades para interpretar como leis existentes se aplicam a novas tecnologias, levando a um ambiente de insegurança jurídica que desencoraja investimentos e inovações.

-

Soluções Flexíveis Necessárias: Em vez de regulamentações prescritivas, pode ser preferível adotar abordagens baseadas em princípios gerais, que possam ser adaptados conforme a tecnologia evolui.

-

Exemplo Prático: A regulamentação inicial de serviços de compartilhamento de caronas não contemplava a natureza das plataformas digitais modernas, levando a conflitos legais, proibições temporárias e confusão regulatória em várias jurisdições.

-

Desafios para Reguladores: Autoridades regulatórias podem não ter o conhecimento técnico ou a agilidade necessária para acompanhar as inovações, resultando em regulamentações desatualizadas ou inadequadas.

Referências:

-

Thierer, A. (2016). Permissionless Innovation: The Continuing Case for Comprehensive Technological Freedom. Defende uma abordagem de inovação sem permissões, argumentando que a regulação excessiva pode prejudicar o progresso tecnológico.

-

Brownsword, R., & Goodwin, M. (2012). Law and the Technologies of the Twenty-First Century. Analisa os desafios que as tecnologias emergentes colocam para o direito e a regulação.

4. Impacto Econômico e Competitividade Internacional

Argumento: Regulamentações rigorosas podem tornar um país menos atraente para investimentos estrangeiros e empresas de tecnologia, que podem optar por operar em ambientes regulatórios mais favoráveis. Isso pode levar a uma perda de competitividade internacional, redução de empregos no setor tecnológico e atraso no desenvolvimento econômico do país.

Em detalhe:

-

Deslocamento de Empresas: Empresas globais podem escolher estabelecer operações em países com regulamentações menos restritivas, levando à fuga de capital e talento.

-

Custos de Conformidade Elevados: Empresas locais podem enfrentar custos significativos para cumprir regulamentações, reduzindo sua capacidade de competir internacionalmente.

-

Perda de Oportunidades de Mercado: Consumidores podem ter acesso limitado a serviços e produtos inovadores se as empresas decidirem não operar em jurisdições com regulamentações pesadas.

-

Efeito Cascata na Economia: O setor de tecnologia é um vetor importante para o crescimento econômico e a criação de empregos. Regulamentações que restringem esse setor podem ter impactos negativos em toda a economia.

-

Exemplo Prático: Após a implementação de leis rigorosas de proteção de dados ou conteúdo online, algumas empresas globais reduziram ou encerraram suas operações em determinados países, limitando o acesso dos consumidores a serviços populares.

-

Competitividade Global: Países que oferecem ambientes regulatórios favoráveis podem atrair empresas inovadoras, investimentos estrangeiros diretos e talentos qualificados, fortalecendo sua posição na economia global.

Referências:

-

World Economic Forum (2018). The Global Competitiveness Report. Analisa os fatores que influenciam a competitividade de países, incluindo o ambiente regulatório.

-

Porter, M. E. (1990). The Competitive Advantage of Nations. Explora como políticas e condições nacionais afetam a competitividade das indústrias.

5. Riscos à Liberdade de Expressão

Argumento: Regulamentações que impõem obrigações às plataformas para monitorar, moderar ou remover conteúdo podem levar à censura excessiva e limitar o livre fluxo de informação. O equilíbrio entre combater conteúdo nocivo e preservar a liberdade de expressão é delicado, e regulamentações mal calibradas podem infringir direitos fundamentais.

Em detalhe:

-

Excesso de Remoção de Conteúdo (Overblocking): Para evitar penalidades, plataformas podem adotar políticas de moderação excessivamente restritivas, removendo não apenas conteúdo ilegal, mas também expressões legítimas, críticas ou satíricas.

-

Autocensura dos Usuários: Se os usuários temem que suas postagens possam ser removidas ou que possam sofrer consequências legais, podem evitar expressar opiniões controversas ou participar de debates públicos, empobrecendo o discurso democrático.

-

Responsabilidade das Plataformas vs. Liberdade de Expressão: Exigir que as plataformas sejam responsáveis pelo conteúdo gerado pelos usuários pode incentivá-las a monitorar ativamente todas as comunicações, o que levanta preocupações sobre privacidade e liberdade de expressão.

-

Variedade Cultural e Contexto: Determinar o que constitui conteúdo nocivo ou ilegal pode ser complexo e variar de acordo com contextos culturais, políticos e sociais. Regulamentações rígidas podem não levar em conta essas nuances.

-

Exemplo Prático: Leis que exigem a remoção de “discursos de ódio” podem ser utilizadas para silenciar minorias ou dissidentes políticos, dependendo da definição aplicada e da forma como são implementadas.

-

Princípios Internacionais de Direitos Humanos: Organizações como a ONU e a Anistia Internacional enfatizam que quaisquer restrições à liberdade de expressão devem ser necessárias, proporcionais e previstas em lei clara.

Referências:

-

MacKinnon, R. (2012). Consent of the Networked: The Worldwide Struggle for Internet Freedom. Analisa as ameaças à liberdade de expressão online e a importância de proteger os direitos digitais.

-

La Rue, F. (2011). Report of the Special Rapporteur on the Promotion and Protection of the Right to Freedom of Opinion and Expression. Documento das Nações Unidas que aborda desafios à liberdade de expressão na era digital.

Considerações Finais sobre os Argumentos Contra a Regulação:

Os argumentos contra a regulação das plataformas digitais destacam os potenciais efeitos negativos que regulamentações excessivas ou mal concebidas podem ter sobre a inovação, a economia, a liberdade individual e a eficácia das medidas propostas. Defensores dessa posição argumentam que é necessário cautela ao elaborar políticas regulatórias, para evitar consequências indesejadas que possam prejudicar tanto o desenvolvimento tecnológico quanto os direitos fundamentais dos cidadãos.

A abordagem sugerida é a de buscar um equilíbrio, considerando alternativas como a autorregulação, códigos de conduta voluntários e a aplicação de princípios gerais em vez de regras rígidas e específicas. A importância de preservar um ambiente propício à inovação, respeitando ao mesmo tempo os direitos individuais e promovendo o bem-estar social, é enfatizada como um objetivo central.

Propostas para o Brasil

1. Estabelecimento de uma Regulação Equilibrada e Flexível

Objetivo: Criar um marco regulatório abrangente que proteja os direitos dos usuários, promova a concorrência leal e incentive a inovação tecnológica, sem impor barreiras excessivas às empresas.

Por quê: A ausência de uma regulação específica para plataformas digitais no Brasil pode levar a abusos de poder de mercado, violações de privacidade e prejuízos aos consumidores. Por outro lado, regulamentações excessivamente rígidas podem sufocar a inovação e dificultar a competitividade das empresas nacionais no cenário global. É essencial encontrar um equilíbrio que permita o desenvolvimento sustentável do setor digital, assegurando proteção aos usuários e estímulo ao crescimento econômico.

Como fazer:

-

Consulta Pública e Participação Multissetorial: Iniciar um processo legislativo que envolva governo, setor privado, academia e sociedade civil, garantindo que diversas perspectivas sejam consideradas na elaboração das leis.

-

Análise de Modelos Internacionais: Estudar e adaptar as melhores práticas de regulações bem-sucedidas em outros países, como o DSA e DMA da União Europeia, ajustando-as ao contexto brasileiro.

-

Flexibilidade Normativa: Incorporar mecanismos de revisão periódica das regulamentações, permitindo ajustes conforme a tecnologia e o mercado evoluem.

-

Definições Claras e Precisas: Estabelecer conceitos bem definidos para termos-chave como “plataforma digital”, “algoritmos de recomendação” e “conteúdo ilegal” para evitar ambiguidades legais.

-

Proporcionalidade de Obrigações: Diferenciar as obrigações regulatórias com base no tamanho e impacto das plataformas, evitando onerar desnecessariamente startups e pequenas empresas.

2. Responsabilização das Plataformas sem Comprometer a Liberdade

Objetivo: Assegurar que as plataformas digitais sejam responsabilizadas por conteúdos e ações que causem danos aos usuários e à sociedade, sem infringir a liberdade de expressão e outros direitos fundamentais.

Porquê: As plataformas influenciam significativamente o fluxo de informação e podem amplificar conteúdos prejudiciais por meio de seus algoritmos. Sem mecanismos de responsabilização, práticas nocivas como desinformação, discurso de ódio e manipulação podem proliferar. No entanto, é crucial que a responsabilização não resulte em censura ou restrinja indevidamente a liberdade de expressão.

Como fazer:

-

Transparência Algorítmica: Exigir que plataformas divulguem informação sobre o funcionamento de seus algoritmos de recomendação, incluindo critérios utilizados para priorização de conteúdos.

-

Mecanismos de Apelação e Revisão: Estabelecer procedimentos claros para que usuários possam contestar decisões de moderação, garantindo o direito ao devido processo.

-

Co-regulação e Autorregulação: Incentivar a criação de códigos de conduta e práticas éticas pelas próprias plataformas, em alinhamento com diretrizes regulatórias.

-

Responsabilidade Proporcional: Aplicar sanções de acordo com a gravidade da infração e o porte da plataforma, evitando punições desproporcionais que possam inviabilizar operações legítimas.

-

Proteção da Liberdade de Expressão: Garantir que medidas contra conteúdos ilegais não afetem a expressão legítima, preservando o debate público e a diversidade de opiniões.

3. Proteção de Crianças e Adolescentes com Salvaguardas de Privacidade

Objetivo: Implementar medidas que protejam crianças e adolescentes dos riscos presentes nas plataformas digitais, como exposição a conteúdos inadequados e aliciamento, ao mesmo tempo em que resguardam a privacidade de todos os usuários.

Porquê: Menores de idade são especialmente vulneráveis no ambiente digital e podem sofrer danos que impactam seu desenvolvimento e segurança. Contudo, soluções como a verificação de idade e identidade podem comprometer a privacidade e levar à coleta excessiva de dados pessoais. É necessário proteger os jovens sem sacrificar os direitos de privacidade dos usuários em geral.

Como fazer:

-

Tecnologias de Verificação de Idade Não Invasivas: Desenvolver métodos que confirmem a idade dos usuários sem coletar dados pessoais sensíveis, como análise de comportamento de navegação ou uso de certificados de idade emitidos por autoridades confiáveis.

-

Configurações Padrão de Privacidade Elevada: Exigir que contas de menores de idade tenham, por padrão, configurações que limitam a exposição e interação com desconhecidos.

-

Educação e Conscientização: Promover programas educacionais que orientem crianças, adolescentes e responsáveis sobre segurança online, privacidade e uso responsável da internet.

-

Parcerias com Organizações Especializadas: Colaborar com entidades que atuam na proteção de menores para desenvolver políticas eficazes e atualizadas.

-

Mecanismos de Denúncia e Suporte: Estabelecer canais acessíveis e eficientes para reportar comportamentos inadequados e oferecer apoio às vítimas.

4. Fortalecimento da Educação Digital

Objetivo: Capacitar a população para o uso consciente, crítico e seguro das plataformas digitais, promovendo a alfabetização midiática e digital em todas as faixas etárias.

Porquê: A educação é fundamental para que os cidadãos compreendam os riscos e oportunidades do ambiente digital, evitando a disseminação de desinformação e protegendo-se contra fraudes e violações de privacidade. Uma população bem informada contribui para um ecossistema digital mais saudável e resiliente.

Como fazer:

-

Inclusão nos Currículos Escolares: Integrar disciplinas de educação digital nas escolas, abordando temas como segurança online, ética digital e pensamento crítico.

-

Formação de Educadores: Capacitar professores e profissionais da educação para ensinar habilidades digitais e orientar alunos sobre os desafios do mundo online.

-

Campanhas de Conscientização: Desenvolver iniciativas públicas que alcancem a população em geral, incluindo idosos e grupos vulneráveis, sobre boas práticas no uso da internet.

-

Parcerias Público-Privadas: Colaborar com empresas de tecnologia e organizações da sociedade civil para ampliar o alcance e a eficácia dos programas educacionais.

-

Acesso a Recursos Didáticos: Disponibilizar materiais educativos gratuitos e acessíveis, incluindo plataformas online, aplicativos e conteúdo multimídia.

5. Cooperação Internacional e Adaptação de Boas Práticas

Objetivo: Engajar-se ativamente em iniciativas globais para a regulação de plataformas digitais, adaptando experiências bem-sucedidas ao contexto brasileiro e contribuindo para a formulação de normas internacionais.

Porquê: As plataformas operam globalmente, e muitos dos desafios são compartilhados entre nações. A cooperação internacional permite o compartilhamento de conhecimento, fortalece a capacidade de resposta a problemas transnacionais e evita a fragmentação regulatória que pode prejudicar a eficácia das medidas adotadas.

Como fazer:

-

Participação em Fóruns Internacionais: Integrar grupos como o Global Privacy Assembly e o G20 Digital Economy Working Group, contribuindo para debates e decisões sobre políticas digitais.

-

Acordos Bilaterais e Multilaterais: Firmar parcerias para cooperação em áreas como proteção de dados, cibersegurança e combate a crimes cibernéticos.

-

Adaptação Cultural e Legal: Ao implementar boas práticas internacionais, ajustar as políticas para refletir as particularidades culturais, sociais e legais do Brasil.

-

Promoção de Intercâmbio Técnico: Facilitar a troca de conhecimentos e experiências entre profissionais brasileiros e estrangeiros por meio de conferências, workshops e programas de capacitação.

-

Monitoramento de Tendências Globais: Acompanhar continuamente as evoluções nas regulamentações internacionais para antecipar desafios e oportunidades, adaptando as estratégias nacionais de acordo.

Conclusão

A regulação de plataformas digitais no Brasil é um desafio complexo e multidimensional que requer uma abordagem estratégica e adaptada às especificidades do país. As propostas deste artigo evidenciam a necessidade de equilibrar a proteção dos direitos dos usuários com a promoção da inovação e o desenvolvimento econômico.

Ao estabelecer uma regulação equilibrada e flexível, o Brasil pode criar um ambiente propício à inovação tecnológica, garantindo a proteção dos direitos fundamentais. A responsabilização das plataformas, alinhada com a preservação da liberdade de expressão, assegura que conteúdos prejudiciais sejam controlados sem comprometer o debate público.

A proteção de crianças e adolescentes, com salvaguardas de privacidade, é essencial para garantir um ambiente digital seguro para os jovens, sem violar os direitos de privacidade dos usuários. O fortalecimento da educação digital capacita os cidadãos para um uso consciente e crítico das tecnologias, contribuindo para uma sociedade mais informada e resiliente.

Por fim, a cooperação internacional permite que o Brasil aprenda com as melhores práticas globais e contribua ativamente para a formulação de normas internacionais, posicionando-se como um ator relevante no cenário digital global.

Em suma, a regulação das plataformas digitais é não apenas uma necessidade, mas uma oportunidade para o Brasil liderar pelo exemplo. Ao adotar políticas que equilibram proteção, inovação e competitividade, o país pode garantir que o ambiente digital seja um espaço que promove o bem-estar social, a inclusão e o desenvolvimento econômico sustentável, fortalecendo sua democracia e sua posição no cenário internacional.