asilomar, califórnia, fevereiro de 2009: um seminário de alto nível, reunindo alguns dos principais especialistas em inteligência artificial do planeta, discute se deveríamos impor limites às pesquisas que podem levar à perda de controle humano sobre sistemas computacionais autônomos. estamos falando de sistemas que começam a realizar um conjunto cada vez maior de funções que nos acostumamos a pensar privativas de pessoas como nós, tipo conversar ao telefone, dirigir veículos, realizar funções sofisticadas como acompanhante, assistente ou secretária e… ir à guerra.

neste último quesito, o grupo de asilomar concluiu que… robots that can kill autonomously are either already here or will be soon: já existem ou existirão, muito em breve, robôs que capazes matar de forma autônoma. isso significa, em português bem claro, máquinas capazes de selecionar um alvo que atenda seus objetivos [supostamente definidos por humanos] e eliminá-lo, sem que para isso seja preciso intervenção humana.

no fim de 2007, o departamento de defesa dos estados unidos publicou um documento [Unmanned Systems Roadmap: 2007-2032] que define a estratégia americana para “guerra sem gente”, que não é pura e simples aventura dos generais no campo de tecnologia. a lei 106-398, aprovada pelo congresso em 2001, define na seção 220 que, a partir de 2010, um terço das aeronaves em operações “deep strike” [sem cobertura, em território hostil] sejam não tripuladas e, para 2015, determina que um terço de todos os veículos de combate terrestre sejam não tripulados.

em 2007, uma nova lei [a 109-364] passou a exigir [na seção 941.2] que os comandantes militares, ao contratar o desenvolvimento de um sistema tripulado, se certifiquem que as demandas do programa correspondente não podem ser atingidas por sistemas não tripulados. o plano de longo prazo para sistemas militares não tripulados é uma exigência legal que, talvez nos EUA mais do que por aqui, mandada pelo legislativo, deve ser cumprida pelo executivo.

algum problema nisso? o “roadmap” original e sua revisão, de 2009 [cuja capa você vê na figura abaixo] não mencionam a palavra ética uma vez sequer. mas, você diria, guerra tem ética? tem sim. a guerra tem leis e regras de engajamento, e deixar de cumpri-las torna os marginais criminosos de guerra, como foi o caso de slobodan milošević.

um estudo da calPoly [Autonomous Military Robotics: Risk, Ethics, and Design], preparado para a marinha americana, começa…

Imagine the face of warfare with autonomous robotics: Instead of our soldiers returning home in flag‐draped caskets to heartbroken families, autonomous robots—mobile machines that can make decisions, such as to fire upon a target, without human intervention—can replace the human soldier in an increasing range of dangerous missions: from tunneling through dark caves in search of terrorists, to securing urban streets rife with sniper fire, to patrolling the skies and waterways where there is little cover from attacks, to clearing roads and seas of improvised explosive devices (IEDs), to surveying damage from biochemical weapons, to guarding borders and buildings, to controlling potentially‐hostile crowds, and even as the infantry frontlines.

…criando um cenário de guerra cada vez mais sem seres humanos e, em parte, sem intervenção humana em sua condução. um pouco mais na frente, o relatório alerta para os problemas embutidos no cenário…

Technology, however, is a double‐edge sword with both benefits and risks, critics and advocates; and autonomous military robotics is no exception, no matter how compelling the case may be to pursue such research. The worries include: where responsibility would fall in cases of unintended or unlawful harm, which could range from the manufacturer to the field commander to even the machine itself; the possibility of serious malfunction and robots gone wild; capturing and hacking of military robots that are then unleashed against us; lowering the threshold for entering conflicts and wars, since fewer US military lives would then be at stake; the effect of such robots on squad cohesion, e.g., if robots recorded and reported back the soldier’s every action; refusing an otherwise‐legitimate order; and other possible harms.

…incluindo responsabilidades das partes envolvidas [inclusive as das máquinas, claro], captura e hacking de robôs, possivelmente convertidos em inimigos de seus donos originais, o efeito de robôs em grupos de batalha mistos [humanos e máquinas] e a maior “facilidade” de entrar em guerra, devido ao menor número de vidas [e risco, inclusive político] envolvido.

o estudo da calPoly não é mero exercício acadêmico. as máquinas estão indo à guerra: não estamos discutindo se deveríamos usar robôs em conflitos, qual santos dumont refletindo sobre usos militares de uma de suas invenções. precisamos discutir e avaliar, rápida e profundamente, quais são as consequências dos sistemas autônomos e robôs na guerra, realidade que nos afeta agora.

o orçamento americano para sistemas de defesa “não tripulados” é de pelo menos US$20B para o período 2009-2013. os americanos têm centenas de UAV e milhares de outras máquinas de todos os tipos. mas, se o orçamento americano é, disparado, o maior do mundo para tais sistemas, estima-se que outros quarenta países e organizações [como o hezbollah, há anos] tenham acesso, hoje, a UAVs, veículos aéreos de ataque não tripulados como os que mostramos no primeiro texto da série.

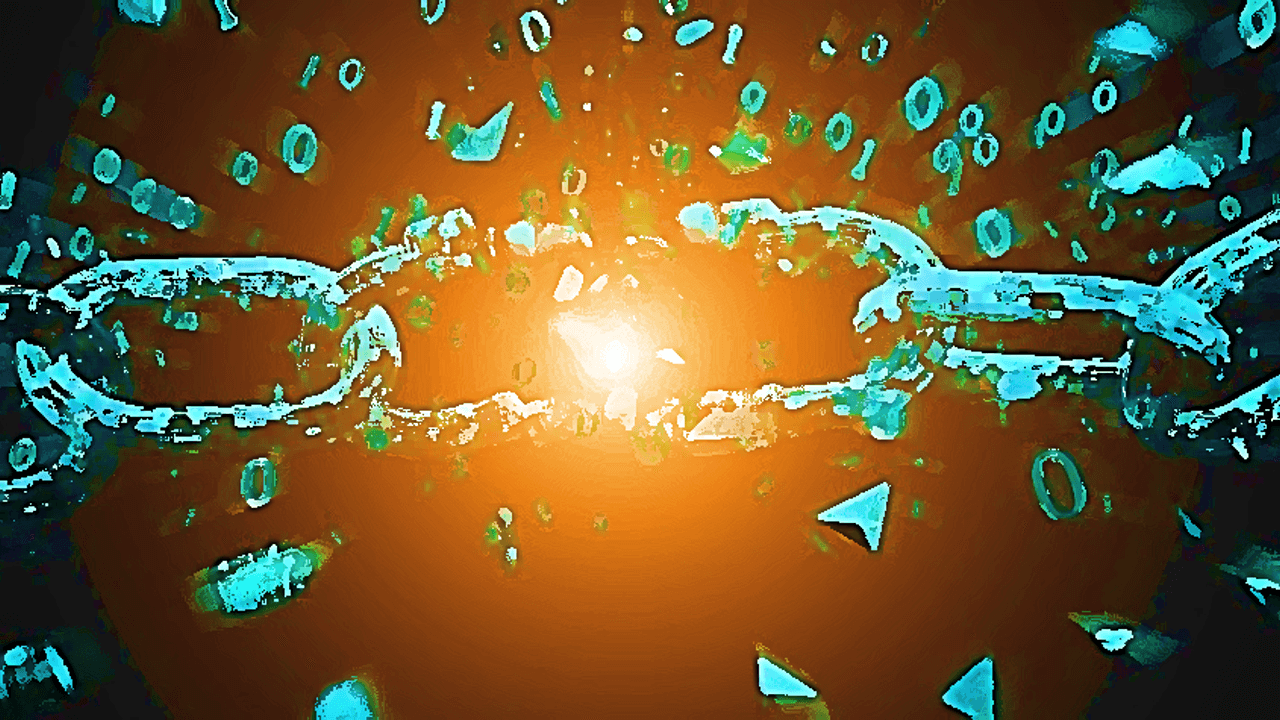

ao contrário de artefatos nucleares, de dificílima obtenção e alvo de severa fiscalização e controle, sistemas autônomos e inteligentes podem ser construídos e programados por muita gente, em qualquer lugar e para quase qualquer tipo de situação. o conhecimento correspondente está publicado em livros, jornais e revistas, existe em muito larga escala na internet e os sub-sistemas e componentes necessários para construir um UAV de ataque podem ser adquiridos com facilidade. exagerando, é como construir um aeromodelo [muito] sofisticado. qualquer dia destes, pode esperar, vamos vê-los em ação no maior conflito urbano brasileiro, a guerra pelo controle do tráfico no rio de janeiro. e nas mãos de vários lados.

voltando a asilomar, e se máquinas capazes de matar estiverem mesmo soltas por aí… e não forem maluquices situadas em distopias datadas em um futuro remoto?… você já ouviu falar de um certo robô [fixo] de patrulha de fronteira da coréia do sul? o país gasta 120.000 homens-ano para patrulhar sua fronteira com a belicosa coréia do norte e a taxa de natalidade local está caindo. daí pra alguém pensar em automatizar o processo, foi um pulo. veja o vídeo abaixo.

pelo que se sabia, o robô seria produzido pela samsung e já deveria estar sendo usado na fronteira entre as coréias. mas, de repente, não se falou mais disso e a informação sobre o “produto” deixou de constar da página da subsidiária da samsung que, em tese, o produz. será que este é um daqueles sistemas que o grupo de asilomar diz que “já existe”?…