[Texto da série “Silvio Meira no G1”, publicado originalmente no G1, em 17/10/2006.]

Muitos anos atrás [uns 20!], eu disse -para escárnio geral da platéia num seminário do Departamento de Física da Universidade Federal de Pernambuco, UFPE- que todas as áreas da ciência eram sub-áreas da computação. Para quem já era da área, naquela época, a introdução cada vez maior de informática – em todos os seus veios e meios, fossem computação, comunicação ou controle- em todas as áreas de atividade, presença ou funcionalidade humanas e, de resto, em tudo ao nosso redor, já significava que todas as áreas de interesse da ciência e do funcionamento da humanidade iriam ter uma componente dela muito importante, senão absolutamente fundamental.

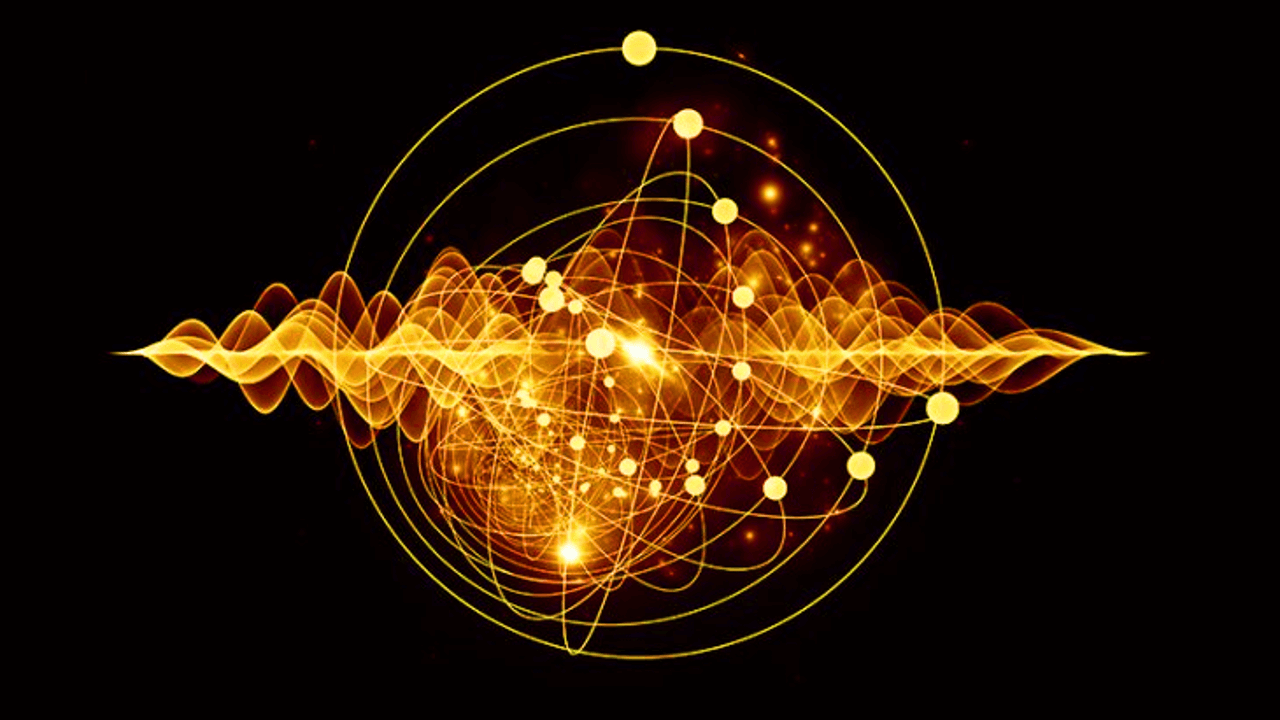

Os anos se passaram: Seth Lloyd, professor do Massachusetts Institute of Technology (MIT), postulou recentemente que o universo é seu próprio computador e que tudo o que vale a pena ser entendido em um sistema qualquer vem do entendimento de como tal sistema processa informação. No livro a “New Kind of Science“, o cientista Stephen Wolfram tem uma tese ainda mais radical [porque trata do que e do como…]: tudo que está ao nosso redor [seja lá o que for] é computacional e, como se não bastasse, é computado por autômatos celulares, pequenos arranjos de bits capazes de processar sua informação e de seus vizinhos, no tempo, e tomar decisões simples a partir daí. Funciona para um monte de coisas [clique aqui para usar um gerador de ringtones para celulares]. Será que resolve todas?… Ninguém, por enquanto, sabe.

Na última edição de Educause Review, Sandra Braman trata parte do assunto [Transformations of the Research Enterprise], especulando sobre computação, redes e dados nas demais ciências. Ela considera o tamanho do problema que vamos ter para capturar, transmitir, processar e administrar petabytes [quatrilhões… ou quinze zeros… ‘000.000.000.000.000] de dados que experimentos poderão gerar –como será o caso do novo acelerador de partículas do Centro Europeu de Pesquisa Nuclear (CERN), o Large Hadron Collider (LHC)–, transformando a física, por exemplo, em uma ciência intensiva, quase que inteiramente dependente, de computação. Afinal de contas, segundo Lloyd, o que estaremos fazendo é construir computadores [ou programas de computador] para simular o comportamento de outros computadores “naturais” –o mundo lá fora– cujo funcionamento queremos entender.

Uma coisa é certa: à medida que entendemos mais o universo ao nosso redor, boa parte dele pode ser modelada, e quase toda a modelagem que nós fazemos do universo de informação ao nosso redor é computacional.

Quer ver? Olhe a descrição do trabalho que fez Roger Kornberg ganhar o prêmio Nobel de Química de 2006: “Kornberg… descreveu como informação é retirada dos genes e convertida em moléculas chamadas RNA mensageiro… estas moléculas transportam a informação às fábricas de proteínas dentro das células”… O Nobel de Química foi dado, na verdade, para processamento de informação.

Isso se repete por onde quer que olhemos no cenário atual de ciência e tecnologia, e irá se espalhar, com o tempo, para toda a sociedade. Olhemos [literalmente] para astronomia. Sabe o que está para acontecer? Um único telescópio vai começar a gerar vinte terabytes de informação por dia.

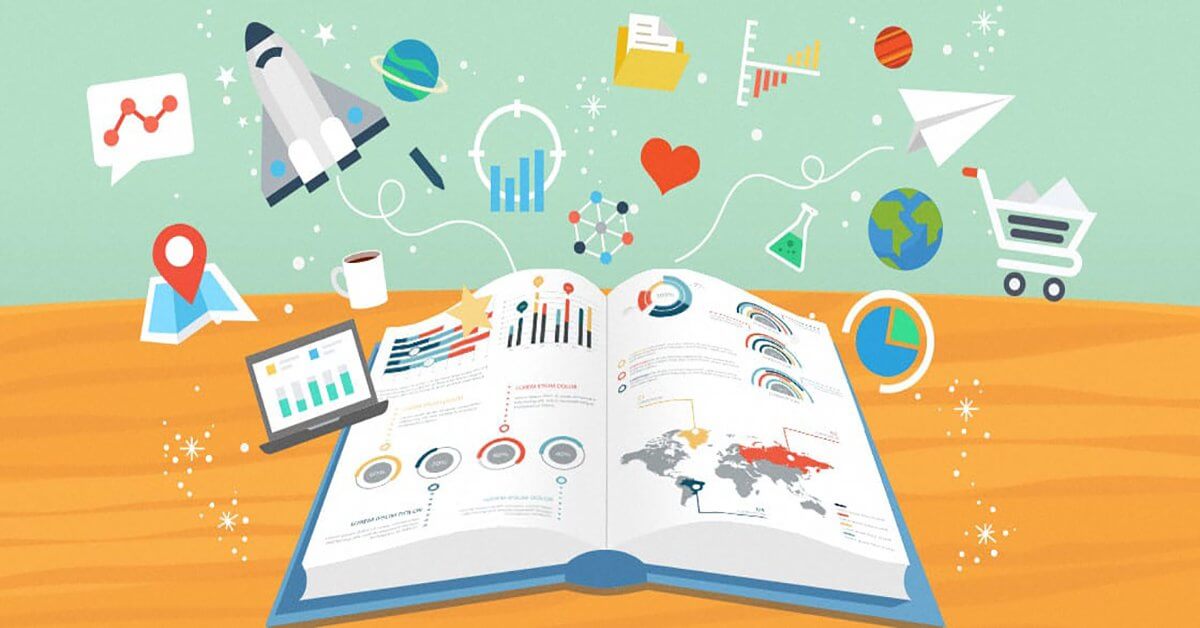

Aliás, por noite… pois há de olhar para o céu noturno, excluindo a influência de nosso Sol. Qual o tamanho de tal montanha de informação? Vejamos: um terabyte é um milhão de megabytes, ou 1.000.000 megabytes. Pra quem não é de informática ou ciências, é bom explicar que “um mega” significa um milhão; ou seja, quando pensamos em um terabyte, estamos olhando para uma quantia que tem 12 zeros, o quase ininteligível trilhão. Costumava-se dizer, no passado [uns dez anos atrás] que a “Encyclopaedia Britannica” tinha cerca de um gigabyte [um bilhão de caracteres, contando as imagens]… e era mais ou menos verdade, porque uma versão da coisa cabia num CD [onde se pode comprimir algo perto de um gigabyte de informação].

Olhando [mesmo!] para os 20 terabytes por noite do nosso telescópio, e levando em conta que “um tera” equivale a 1.000 giga, é o mesmo que pensar num único instrumento de observação dos fenômenos do universo a gerar informação equivalente a 20.000 Britannicas, toda noite, noite após noite. O responsável por tal feito será o Large Synoptic Survey Telescope (LSST), um telescópio de 8.4 metros de diâmetro, americano, que ficará no norte do Chile [no Cerro Pachón], operacional em 2012, com uma câmera de três giga [bilhões!] pixels, uma resolução mil vezes maior do que a câmera digital média que está no mercado hoje, como a que você provavelmente usa para fotografar as estripolias de seus filhos. Cada “foto” do LSST, mil das suas. Já pensou?…

Vamos saber muito mais sobre o universo quando o LSST começar a funcionar. Mas vamos, para tal, ter que aprender a tratar quantidades realmente astronômicas de dados. Um dos maiores projetos de astronomia do mundo, o Sloan Digital Sky Survey (SDSS) –levantamento digital do céu, funcionando há anos, financiado em parte pela Alfred P. Sloan Foundation– mostra “apenas” um lote de 12 terabytes de dados. Os resultados podem ser vistos no Skyserver. E isso é somente 60% do que o LSST vai gerar por noite.

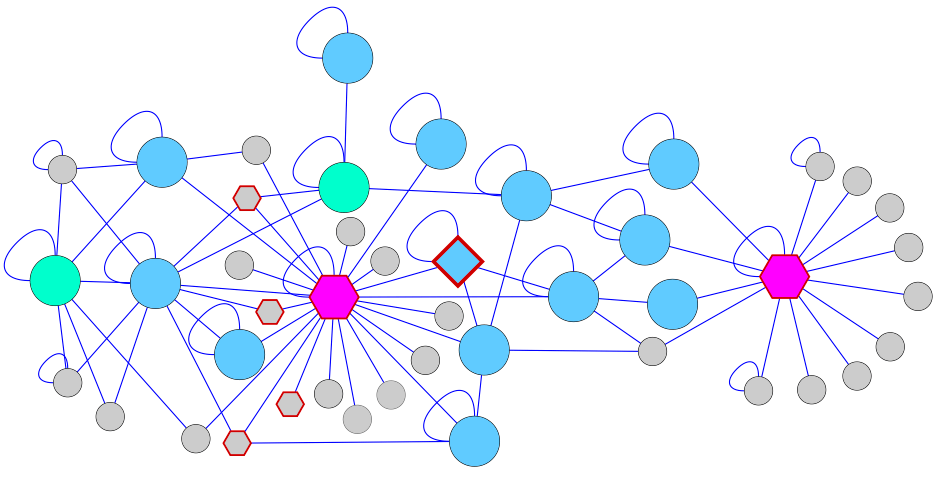

Os problemas e oportunidades para realizar eScience [“ciência em rede”… fusão dos modos teórico, experimental e computacional de fazer ciência, baseado em quantidades quase sempre imensas de dados] serão motores muito importantes do desenvolvimento das teorias e tecnologias de computação, comunicação e controle nas próximas décadas. Elas serão usadas como suporte à realização de qualquer tipo de ciência ou tecnologia.

Em breve, não haverá um “e” antes de eScience; a informática simplesmente estará imersa nas ciências todas, como leitura e escrita estão, hoje. E todas as ciências serão da computação… sem que ninguém note ou precise saber explicitamente.

Em resumo, toda a ciência é ciência da computação. Simplesmente porque o universo [inteiro] é computacional. Esta tese, que poderíamos chamar da universalidade da computação, estará na base de quase tudo, em ciência e tecnologia, e será discutida com muito fervor nos próximos muitos anos.